1.1 无法获取逐点的3D速度或3D位移GT

- 缺乏高精度的逐点3D运动数据作为训练和评估的基准。

- 获取真实标注数据的成本高且耗时。

1.2 缺乏开源的3D场景流估计基线网络

- 现有开源代码中没有适用于3D场景流估计的基线网络。

- 现有网络因计算量大和复杂算子众多,难以作为基准。

1.3 多种算子不支持

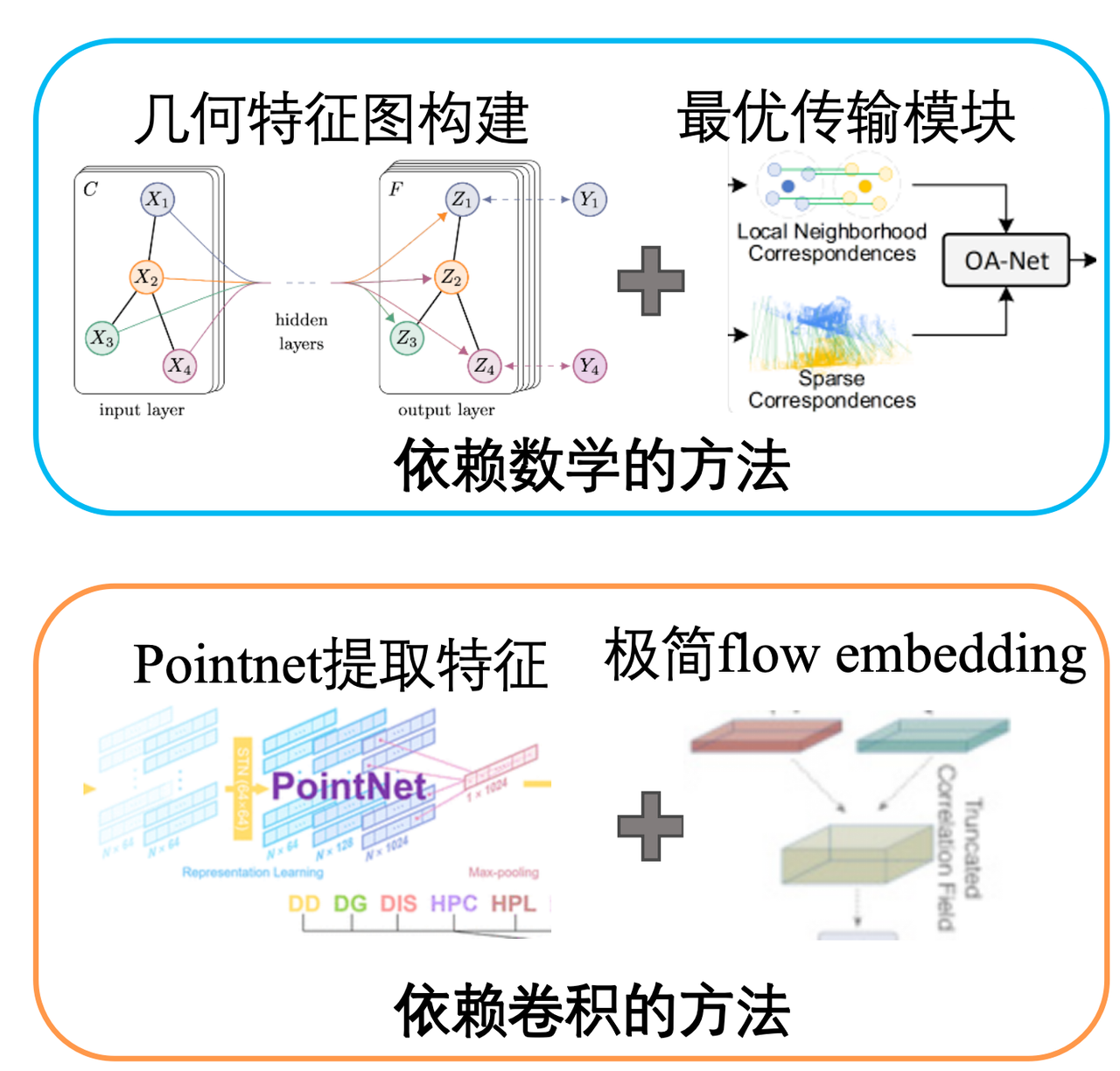

- 常见的3D场景流估计算法涉及多种不兼容或难以实现的算子。

- 导致项目在实际应用中面临实现和优化的挑战。

先进的3D场景流估计与运动分析解决方案

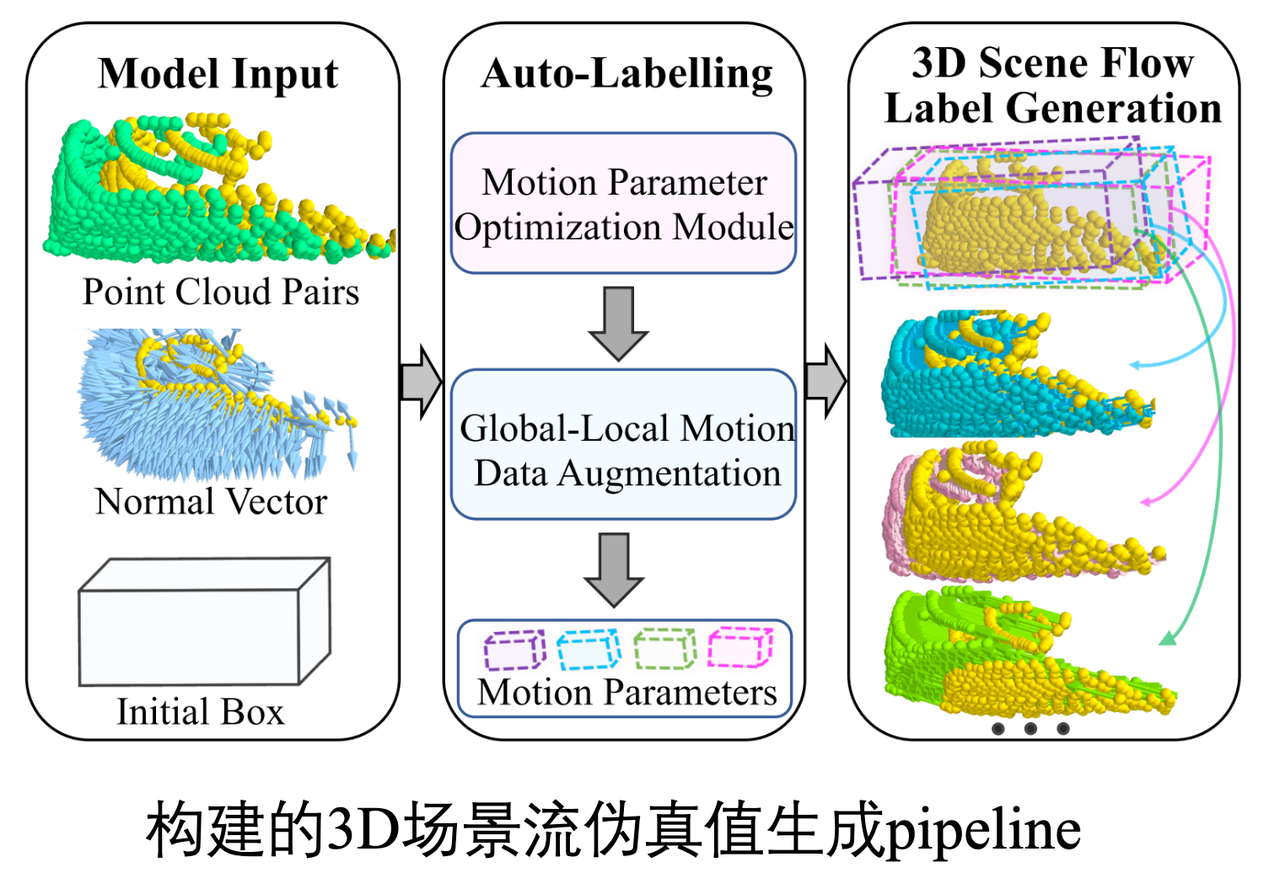

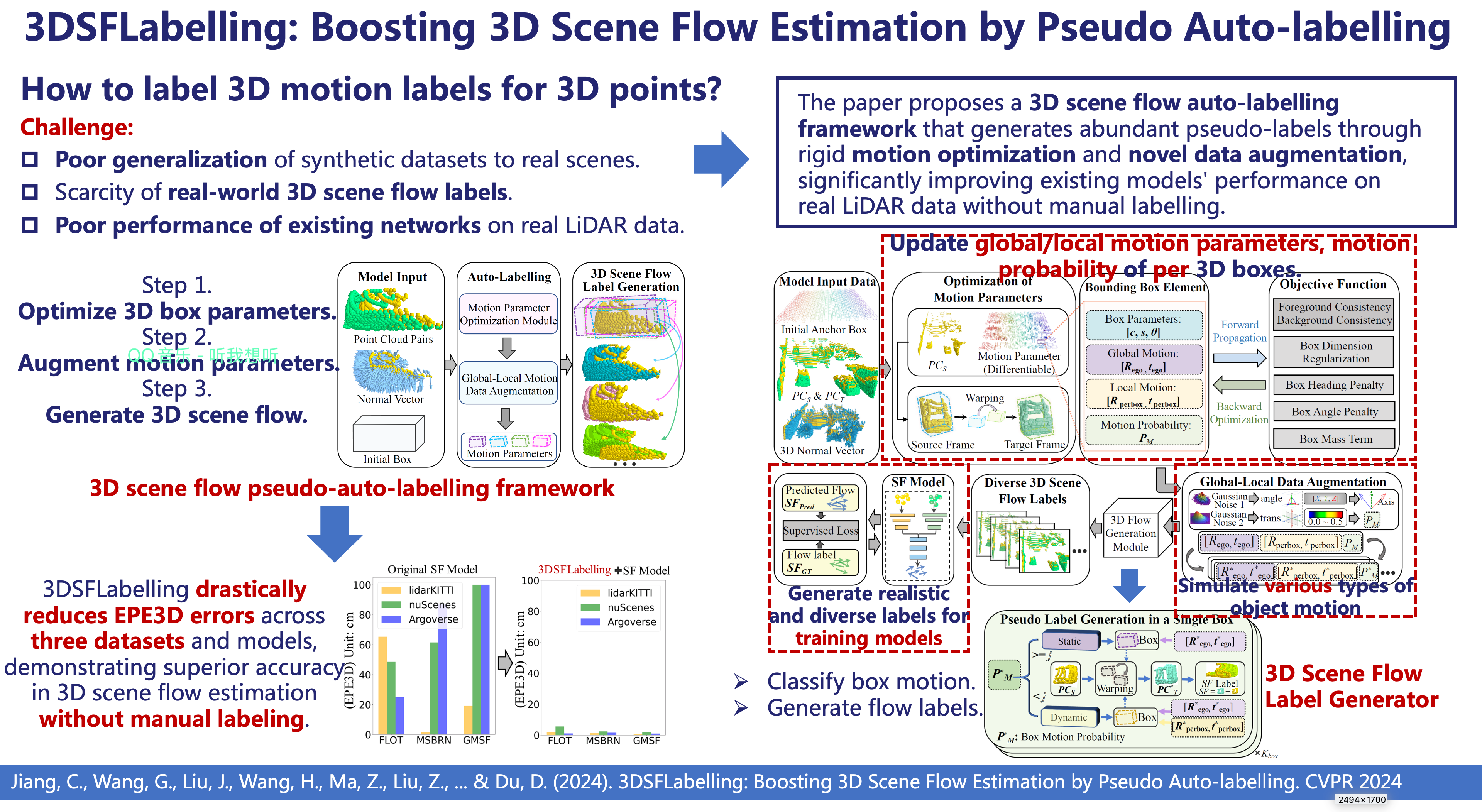

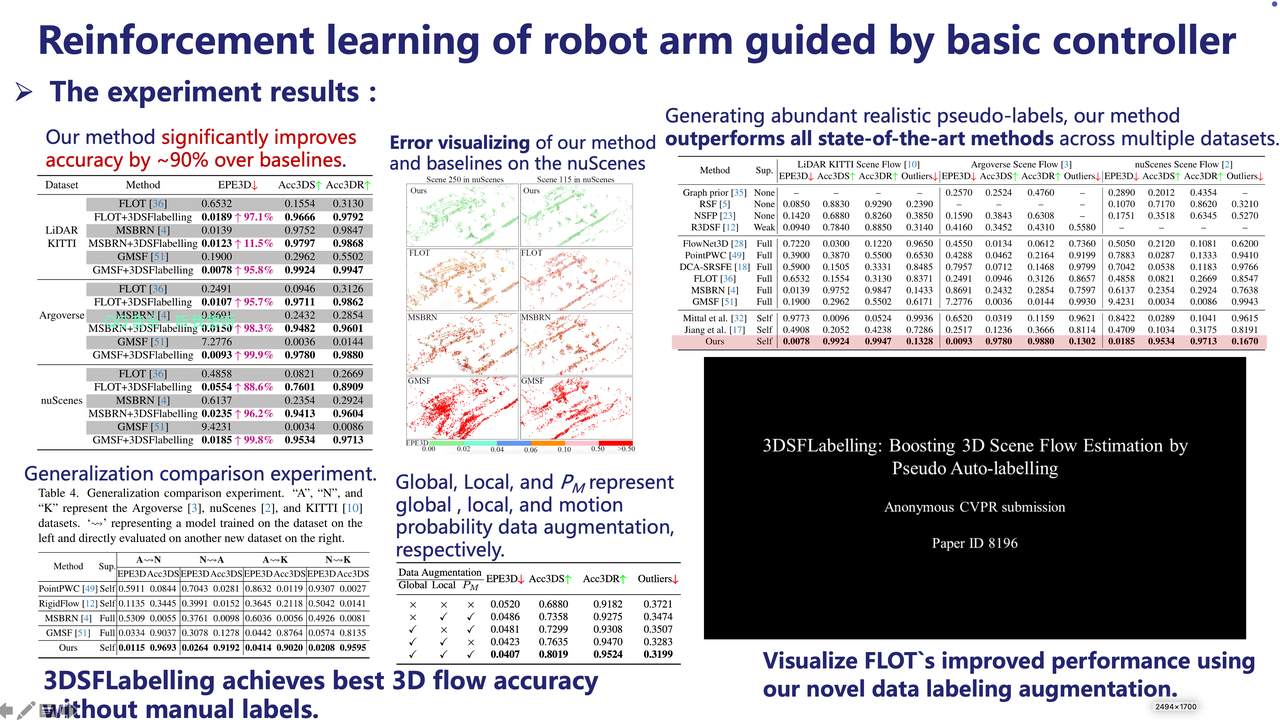

设计和实现了一套自动标注框架,能够高效地为3D场景流估计网络生成准确的标签。该框架利用先进的算法和优化技术,显著减少了手动标注的工作量,并提升了标注的精度和一致性。

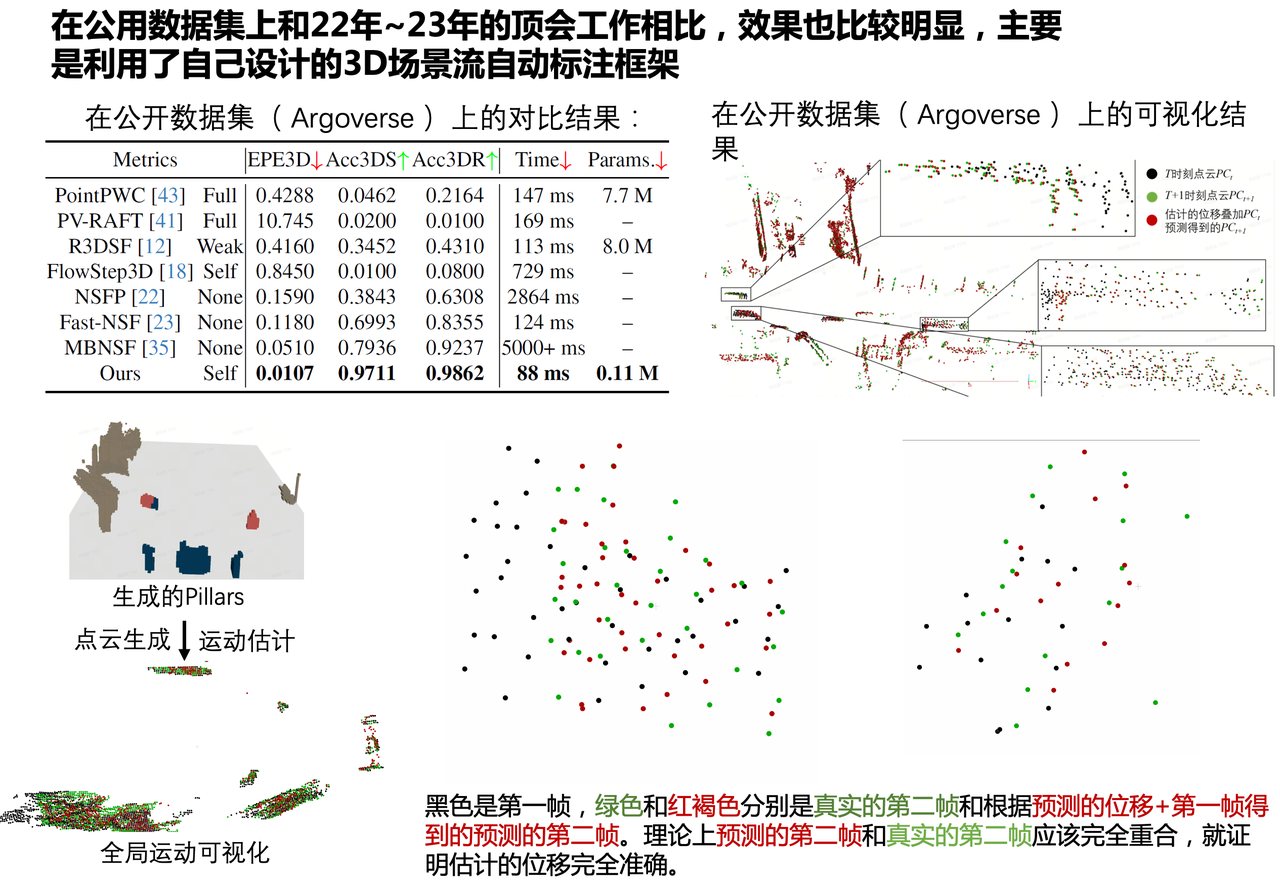

在多个公开数据集上进行了广泛的实验,验证了所构建的3D场景流估计网络的有效性和鲁棒性。实验结果显示,所提方法在精度和计算效率方面均优于现有的基线方法,尤其在复杂场景和高负载条件下表现尤为出色。

标准训练流程包括以下步骤:

在将训练完成的模型部署到英伟达 Orin 和地平线 J6E 等硬件平台时,主要流程如下: