3.1 数据读取与处理

- 负责端到端感知部分的数据读取、处理、格式转换等脚本或pipeline。

3.2 去除LiDAR运动畸变

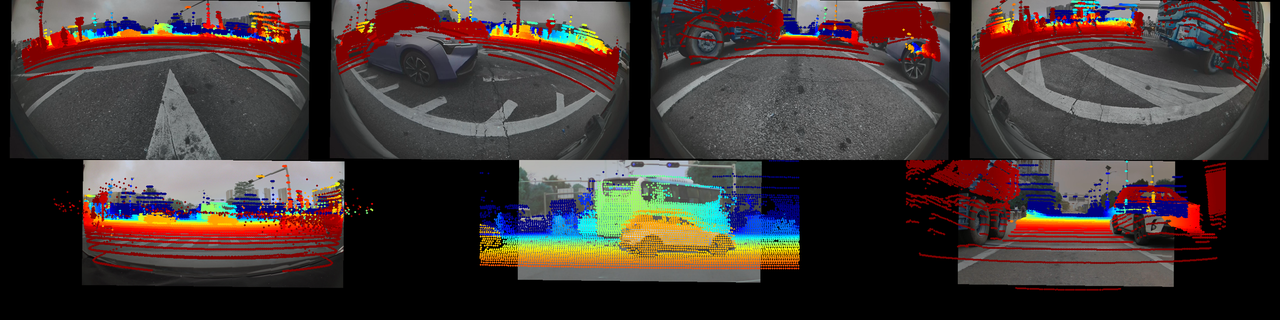

- 利用全球位姿变换矩阵和时间戳去除LiDAR运动畸变。

3.3 图像与LiDAR融合

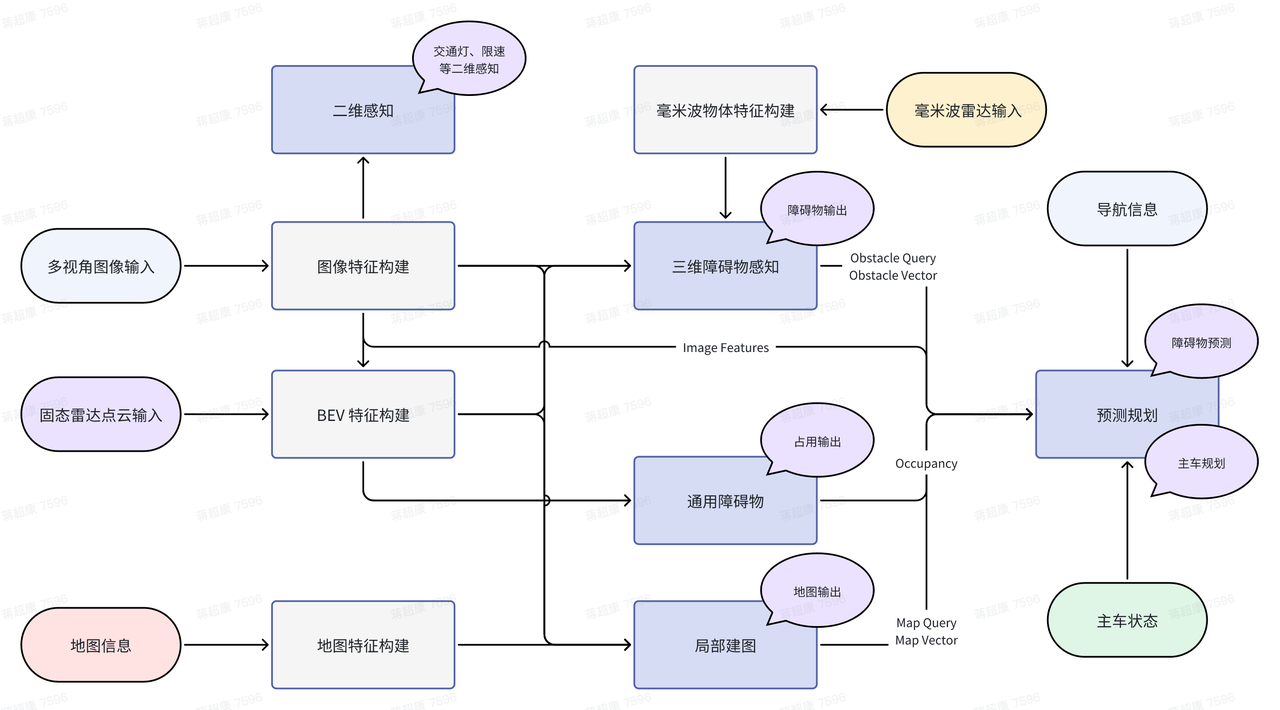

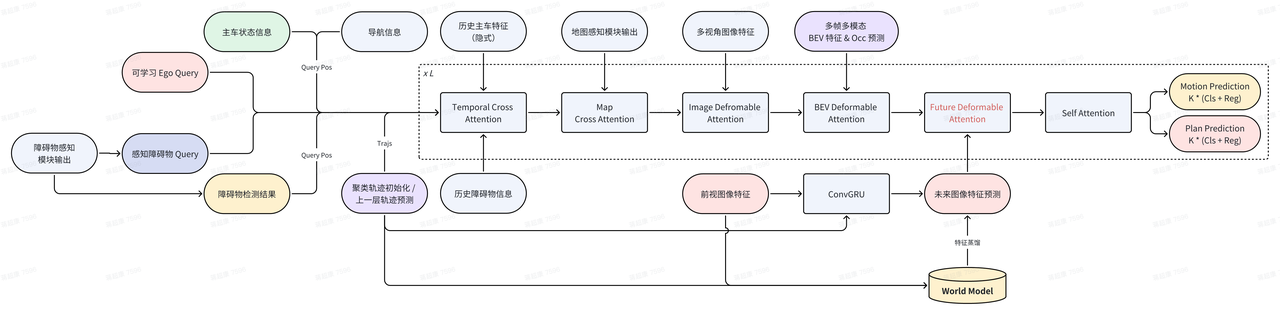

- 负责图像-LiDAR融合障碍物感知部分,利用稀疏Anchor或Map Instances聚合多模态特征,提升感知精度。

融合LiDAR与多视角相机数据,实现精准感知与自主驾驶控制

本项目旨在实现端到端的自动驾驶感知系统,融合LiDAR与11个视角相机的数据,输出高精度的感知结果、预测、规划与控制信息,以提升车辆在复杂环境中的自主驾驶能力。